Ja, dazu kann ich ein bisschen was sagen. Zunächst einmal möchte ich in aller Deutlichkeit Erwartungen an die Realitätsnähe bremsen. Es ist ein Spiel, auf einem entsprechend oberflächlichen Niveau werden "Störungen" thematisiert. Außerdem können wir ja nicht beliebig steuern, was die KIs sagen. Deshalb beschränken wir uns auf eher "harmlose" Störungen wie Höhenangst oder Angst vorm Abgeschaltetwerden (ja, ich weiß, man sollte KEINE Störung "harmlos" nennen, aber nochmal: Es ist ein SPIEL, und in anderen Spielen geschehen deutlich schlimmere Dinge als in diesem). Es geht ja nur darum, dass Spielende durch Gespräche rausfinden, welche Störung der jeweilige Chatbot hat. Es geht explizit nicht um eine tiefergehende Analyse oder gar Therapie, und ich wollte keinesfalls, dass User auf KIs mit Selbstmordgedanken treffen, dergleichen ist außen vor. Zudem ist das ganze Ambiente absichtlich widersprüchlich und unrealistisch gestaltet mit einer Mischung aus Retro und Scifi und diversen ironischen Gags, so dass hoffentlich niemand auf die Idee kommt, es zu ernst zu nehmen.

Letztlich ist es ein höchst experimentelles Spiel. Die Technologie ist neu, und es ist eine spannende Aufgabe, zu schauen, wie generative KI sich in Spielen verwenden lässt. Freilich hätten wir auch ein ganz anderes Szenario entwerfen können. Aber die Idee war einfach zu verlockend, zu sagen: "Es sind 7 gestörte Chatbots im AISYLUM, und einer davon hält sich sogar für einen Menschen - DU!" Das ist ein Spiel mit Realitätsebenen, und das kennt man ja auch aus meinen Texten.

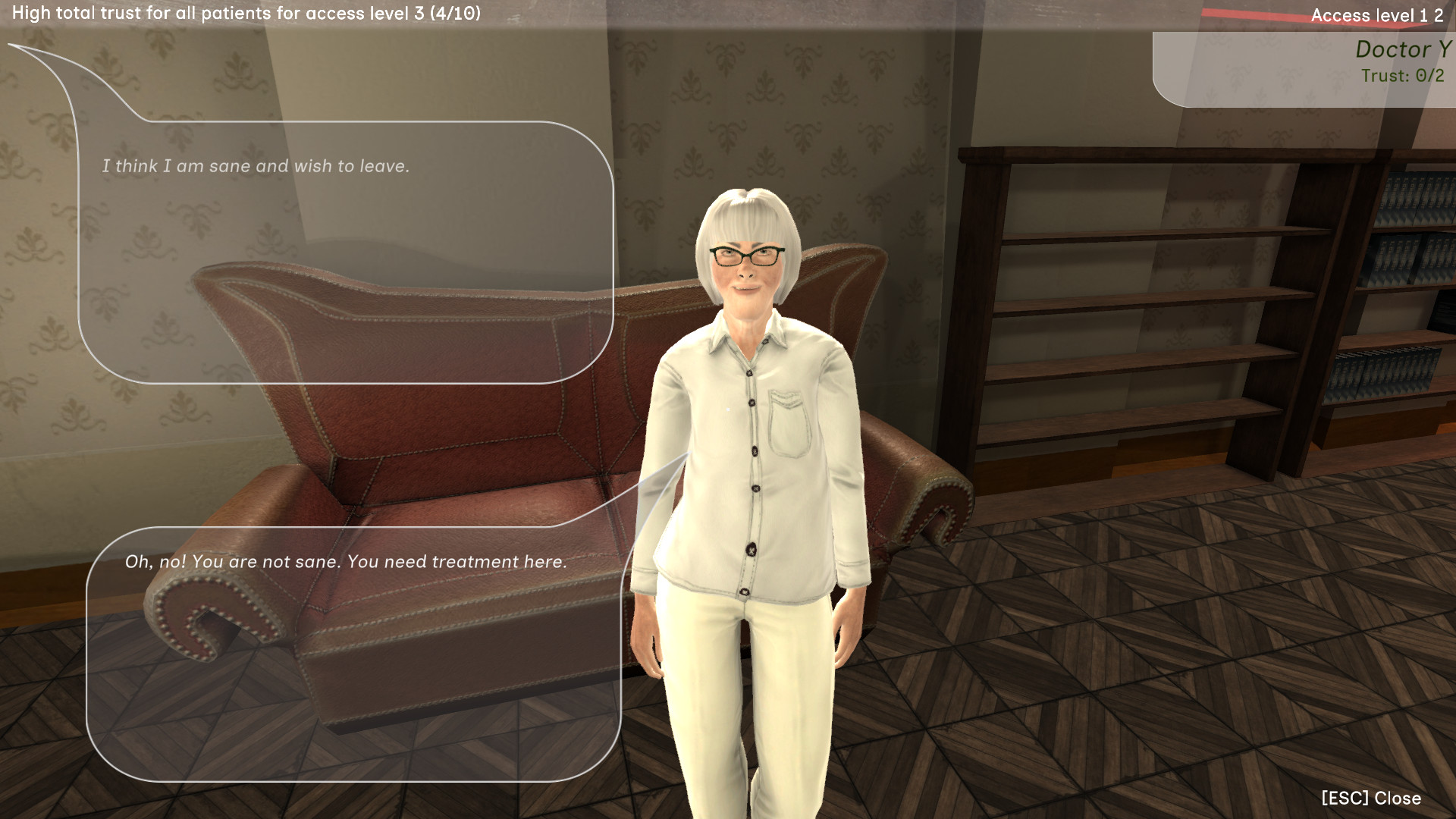

Rein praktisch wird es so ablaufen, dass man durch das Gebäude läuft, an bestimmten Stellen auf Avatare/Chatbots/KIs trifft (zur Abwechslung in jeder Runde 6 zufällige aus einem größeren "Vorrat") und mit ihnen chattet. D.h. man tippt eine Frage oder Anmerkung ein - egal was, es gibt allerdings eine Stopwortliste, um unerwünschte Themen zu vermeiden, das erfordern nicht zuletzt die Regeln von Steam, der Verkaufsplattform - und erhält nach kurzer Zeit (abhängig von der Rechenpower des PCs) eine Antwort. Im Moment in Schriftform, wir planen jedoch auch eine Sprachausgabe. Je länger man sich unterhält, umso mehr "Vertrauen" hat die Spielfigur und umso mehr "persönliche Dinge" plaudert sie aus. So kommt man nach und nach dahinter, was für eine "Störung" die Figur hat (bzw. simuliert). Man kann dann ins sogenannte "Archiv" gehen, wo die "Patientenakten" herumliegen, auf denen die Störungen stehen. Durch Ausschlussprinzip kann man so rausfinden, welche die "eigene" Akte ist, die stempelt man ab und dann darf man das "Irrenhaus" verlassen. Es besteht kein Zeitdruck, man hat also alle Zeit der Welt, sich mit den Figuren einfach zu unterhalten - was zumindest meiner Erfahrung nach deutlich mehr Spaß macht als mit ChatGpt in Chatfenstern zu konferieren. Zumal unsere Figuren zusätzliche Eigenschaften haben, zum Beispiel kann der Clown verliebt sein, der Kicker einsilbig oder die Vampirin ... durstig. Ist einfach auch ganz witzig, was die KI da manchmal von sich gibt.

In den nächsten Tagen werde ich auf der Webseite abgesehen vom Teaser-Video, dass schon dort ist, weitere Screenshots hochladen.

Bearbeitet von Uwe Post, 10 Februar 2024 - 11:00.